Etica e Algoritmi: Le Regole per un’IA più Umana

Parte 4 di 5: Principi per un Futuro Algoritmico Etico

[Questa è la quarta parte della serie sull’algoritmocrazia. Dopo aver esplorato cosa sono gli algoritmi, come discriminano e come ci monetizzano, oggi parliamo di come possiamo costruire un futuro digitale più etico.]

Su Agenda Digitale, agendadigitale.eu, sostengono che dovremmo essere noi a controllare gli algoritmi, non il contrario. Ma spesso non sappiamo nemmeno che esistono. È questo il punto, cioè. Ti fanno una profilazione continua e tu nemmeno te ne accorgi.

Il paradosso della società contemporanea risiede nella nostra incapacità di comprendere i meccanismi che governano le nostre stesse decisioni. Viviamo essenzialmente in un sistema democratico le cui normative risultano redatte in un idioma per noi incomprensibile. E poi manifestiamo sorpresa e indignazione quando gli eventi assumono direzioni sfavorevoli!

La Dimensione Culturale degli Algoritmi

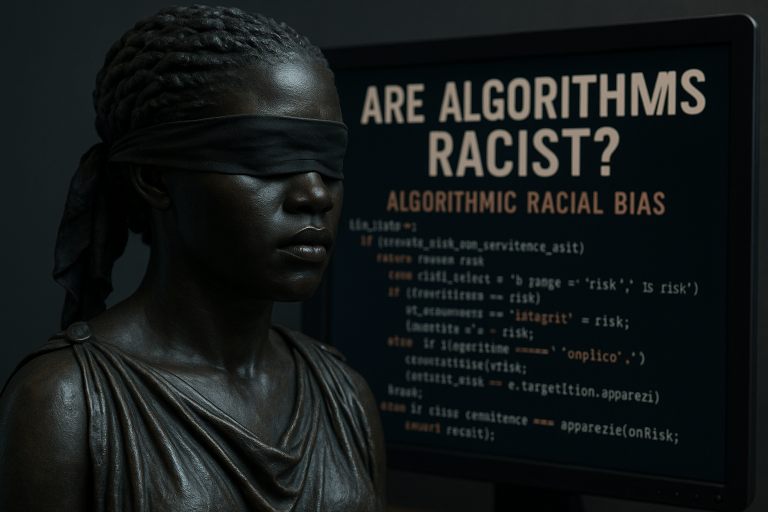

Gli algoritmi non operano nel vuoto: si inseriscono in contesti sociali specifici. Un algoritmo che funziona perfettamente in Svezia potrebbe essere disastroso in Nigeria, non per difetti tecnici ma per differenze culturali. Gli algoritmi incorporano sempre i valori di chi li ha creati. E indovina un po’? La maggior parte sono creati da giovani maschi bianchi della Silicon Valley. Boh, magari non è la demografia più rappresentativa del mondo, no?

E poi c’è la questione della proprietà, che è quella che mi fa incazzare di più. La maggior parte degli algoritmi che governano le nostre vite appartengono a aziende private. Google non rivela come funziona il suo algoritmo di ricerca, Facebook tiene segreti i dettagli del feed. Sono considerati segreti commerciali. Ma questo significa che viviamo in una società dove le regole del gioco sono proprietà privata. È come se le leggi dello stato appartenessero a qualche azienda e non potessimo leggerle. Assurdo!

I Principi per un’Etica Algoritmica

Sai cosa mi ha colpito di più leggendo Benanti? Quando dice che dovremmo sviluppare principi etici specifici per gli algoritmi. Alcuni sembrano fondamentali:

Trasparenza: Avere il diritto di sapere quando un algoritmo prende decisioni che ci riguardano. Non dico che tutti dobbiamo diventare programmatori, ma almeno capire i criteri generali. È come quando vai dal medico: non serve che tu sappia la biochimica, ma vuoi sapere perché ti prescrive quella medicina, no?

Responsabilità: Deve essere sempre chiaro chi risponde delle decisioni algoritmiche. Le aziende non possono nascondersi dietro la complessità tecnica. Se l’algoritmo sbaglia, qualcuno deve pagare. Non puoi dire “eh, il computer ha fatto così” e lavartene le mani.

Controllo umano: Per le decisioni più importanti dovrebbe sempre esserci possibilità di ricorso umano. Gli algoritmi possono consigliare, supportare, ma non sostituire completamente il giudizio umano. Almeno per le robe importanti, tipo lavoro, casa, salute. L’amore magari lo lasciamo ancora a Tinder, che tanto è già un casino di suo!

Inclusività: Gli algoritmi dovrebbero servire tutti, non solo una parte privilegiata della società. Se il tuo algoritmo funziona solo per i maschi bianchi laureati, forse c’è un problema nel design. Giusto per dire.

Le Sfide dell’Implementazione

Ma come implementare questi principi? Servono nuove leggi, istituzioni, competenze. L’Unione Europea sta lavorando a un AI Act, ma la tecnologia si muove più veloce della politica. È come cercare di regolamentare un treno in corsa. Anzi, un treno in accelerazione.

Serve anche alfabetizzazione, ecco. Come nel XX secolo abbiamo imparato tutti a leggere, nel XXI dovremmo imparare i rudimenti degli algoritmi. Non per diventare programmatori, ma per essere cittadini consapevoli. È tipo l’educazione civica, ma per l’era digitale.

Le scuole dovrebbero insegnare a capire criticamente la tecnologia. I giornalisti dovrebbero fare domande intelligenti sugli algoritmi. I politici dovrebbero capire abbastanza per fare leggi sensate. Invece la maggior parte delle volte senti parlamentari che parlano di “il cyber” come se fosse magia nera.

Verso una Consapevolezza Algoritmica

E tutti dovremmo sviluppare consapevolezza di quando interagiamo con algoritmi. La prossima volta che vedi un post sponsorizzato su Facebook, fermati. Chiediti: perché l’algoritmo ha scelto proprio questo contenuto per me? Cosa sa di me? È un esercizio mentale rivelatore. Ti rendi conto di quanto l’algoritmo sa di te, come usa queste informazioni, quanto influenza le tue scelte anche quando pensi di decidere liberamente.

Tipo, ieri stavo guardando YouTube e mi sono accorto che dopo aver visto un video sui gatti mi proponeva solo roba sui gatti. In mezz’ora ero diventato “quello fissato con i gatti” agli occhi dell’algoritmo. E probabilmente mi ha anche mostrato pubblicità di cibo per gatti, lettiere, giocattoli. È inquietante come ti incasella velocemente.

💡 Esercizio pratico: Per una settimana, ogni volta che ricevi una raccomandazione algoritmica (video, prodotti, notizie), chiediti: “Perché proprio questo? Cosa sa di me l’algoritmo?” Annota le tue scoperte. Rimarrai sorpreso da quanto sei prevedibile!

Nel prossimo e ultimo articolo: Esploreremo esperimenti concreti di democrazia algoritmica e i “dark patterns” che ci manipolano ogni giorno. Ma soprattutto, parleremo di come possiamo riprendere il controllo del nostro futuro digitale. La conclusione che ti farà riflettere!

[Questo articolo ti ha fatto pensare? È esattamente quello che serve: più consapevolezza, più controllo. Condividilo con chi credi possa beneficiare di queste riflessioni!]