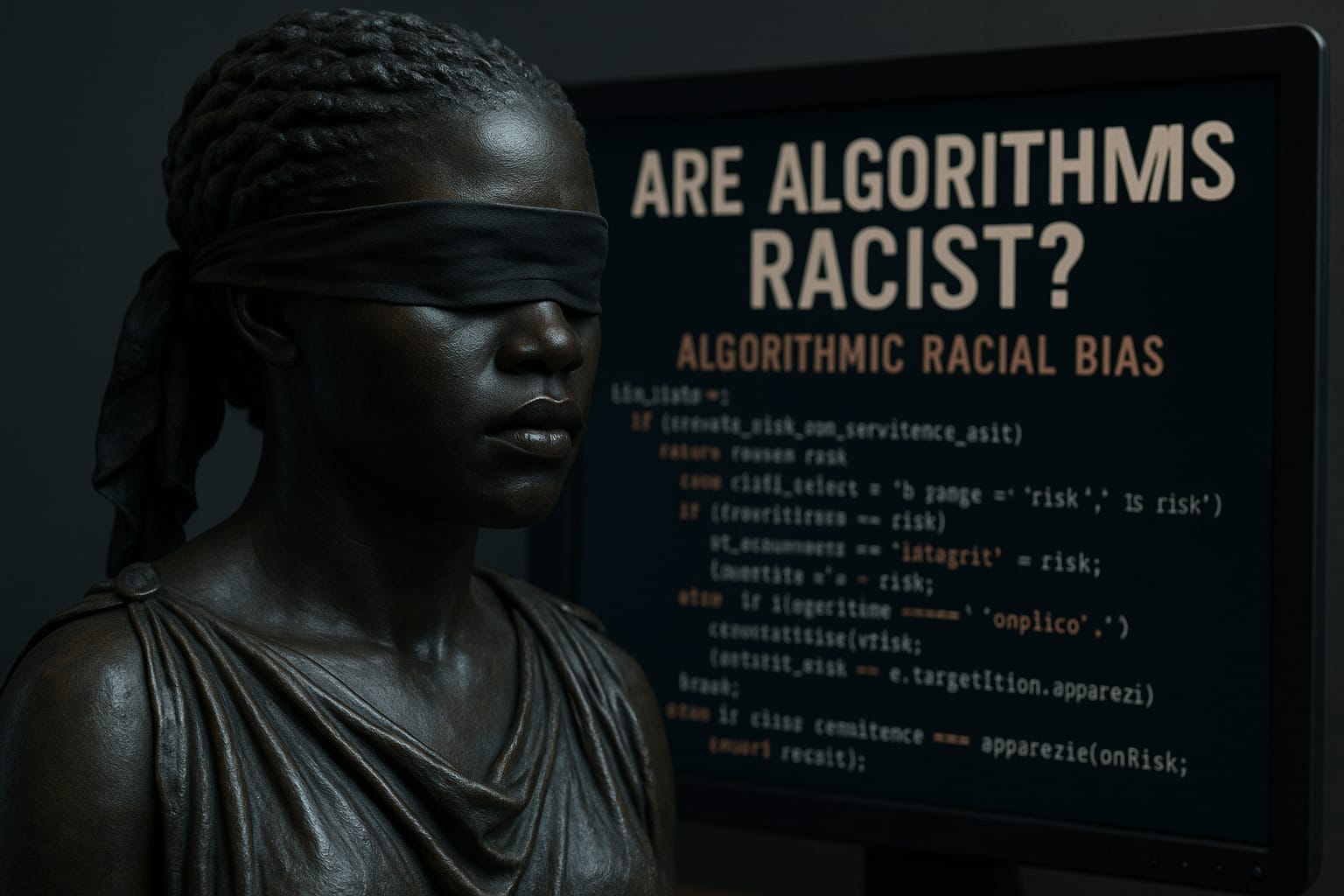

Gli Algoritmi Sono Razzisti? Il Problema della Discriminazione nell’IA

Parte 2 di 5: Il Lato Oscuro degli Algoritmi. Gli algoritmi discriminazione rappresentano uno dei problemi più gravi dell’intelligenza artificiale moderna. Questa è la seconda parte della serie sull’algoritmocrazia. Nel primo articolo abbiamo esplorato cosa sono gli algoritmi e il concetto di “scatole nere”. Oggi scopriamo come sistemi apparentemente neutrali possano perpetuare discriminazioni razziali e sociali attraverso bias algoritmici nascosti.

[Questa è la seconda parte della serie sull’algoritmocrazia. Nel primo articolo abbiamo esplorato cosa sono gli algoritmi e il concetto di “scatole nere”. Oggi scopriamo come sistemi apparentemente neutrali possano perpetuare discriminazioni.]

Cathy O’Neil, nel suo Weapons of Math Destruction, scritto nel 2016 per Crown a New York, ha dimostrato una cosa che fa un po’ paura: questi algoritmi sembrano neutrali – boh, sono solo matematica, no? – ma in realtà amplificano le discriminazioni che già esistono. È tipo quando qualcuno dice “i numeri non mentono mai”, però se i numeri sono sbagliati dall’inizio… Ecco, capisci il problema.

Il Caso COMPAS: Quando l’Algoritmo Diventa Giudice

Ti faccio un esempio che mi ha colpito molto e che ancora adesso mi fa venire i brividi. Negli Stati Uniti usano algoritmi per decidere le sentenze penali. C’è questo sistema che si chiama COMPAS che dovrebbe predire se una persona commetterà altri reati. Sembra una buona idea, vero? Il problema è che ha imparato dai dati del passato, che riflettono decenni di discriminazione razziale. Risultato? Una persona nera ha molte più probabilità di essere classificata come “pericolosa” rispetto a una bianca, anche nelle stesse condizioni.

È un circolo vizioso perfetto: l’algoritmo impara dal passato discriminatorio e perpetua la discriminazione nel futuro. E la cosa più inquietante? Nessuno può vedere come funziona perché è proprietà intellettuale di un’azienda privata. Cioè, stiamo parlando del destino delle persone!

L’Italia e la Rivoluzione Algoritmica

Ma non pensiamo che sia un problema solo americano, eh. Anche qui in Italia stanno iniziando a usare algoritmi simili. Milano li usa per i trasporti pubblici, Roma per la sicurezza urbana. E molte aziende italiane ormai selezionano il personale con algoritmi. Mah, non so se mi fa più paura o più tristezza questa cosa.

Come documentato dalla Britannica, gli algoritmi stanno trasformando il modo in cui viene esercitato il potere nella società moderna. Praticamente stanno studiando come questi sistemi stiano cambiando la governance. Roba seria, non è che stiamo parlando di fantascienza.

La Tua Vita Filtrata dagli Algoritmi

Pensa alla tua giornata tipo. Ti alzi, controlli Facebook: l’algoritmo ha già deciso quali notizie vedere. Vai su LinkedIn: un altro algoritmo sceglie quali opportunità di lavoro mostrarti. Praticamente la nostra vita sociale passa attraverso filtri algoritmici che non capiamo. È come vivere in un mondo dove qualcun altro ha già deciso cosa puoi vedere e cosa no. Un po’ inquietante.

Rifletti su questo: La prossima volta che non ottieni un lavoro per cui ti sei candidato online, chiediti: è stata una persona a scartare il mio CV o un algoritmo che cercava parole chiave specifiche? E se fosse stato l’algoritmo, quali pregiudizi avrebbe incorporato?

__________________________________

Nel prossimo articolo: Entreremo nel mondo del “capitalismo della sorveglianza” con Shoshana Zuboff. Scopriremo come non siamo più i clienti delle big tech, ma il prodotto. Ti mostrerò come gli algoritmi non solo filtrano la realtà, ma la monetizzano, trasformando ogni nostro click in profitto. Non perderti questa inquietante rivelazione!

[Hai trovato interessante questo articolo? Condividilo con chi pensi dovrebbe sapere come gli algoritmi influenzano le nostre vite. La consapevolezza è il primo passo verso il cambiamento.]